SAS总监Reggie Townsend负责推动内部数据伦理措施,在今日大会上揭露今年中将上线的AI模型卡功能,可显示模型各大指标外,还能载明存取人员、修改记录等,以因应AI监管需求。

摄影/王若朴

数据分析大厂SAS在今年度Innovate 2024年会上,继续深化AI和生成式AI产品策略,今日揭露AI监管新工具和服务,包括宛如营养标示卡、整合在主力产品Viya平台的AI模型卡(AI Model Cards)功能,以及可信任AI生命周期(Trustworthy AI Life Cycle)工作流程,可满足美国国家标准暨技术研究院(NIST)制定的AI风险管理框架需求。

AI模型的营养成分表,模型卡清楚标示模型各大关键指标

如何将AI模型以通俗易懂的方式,呈现给所有参与AI生命周期工作中的人员,是一件很困难的事。再加上AI监管法规在世界各地越来越严格,比如台湾去年已有产业主管机关发布金融业运用AI指引、今年政府也将推出AI基本法等,对企业来说,如何呈现模型表现、让监管机构理解,成为另一重要课题。

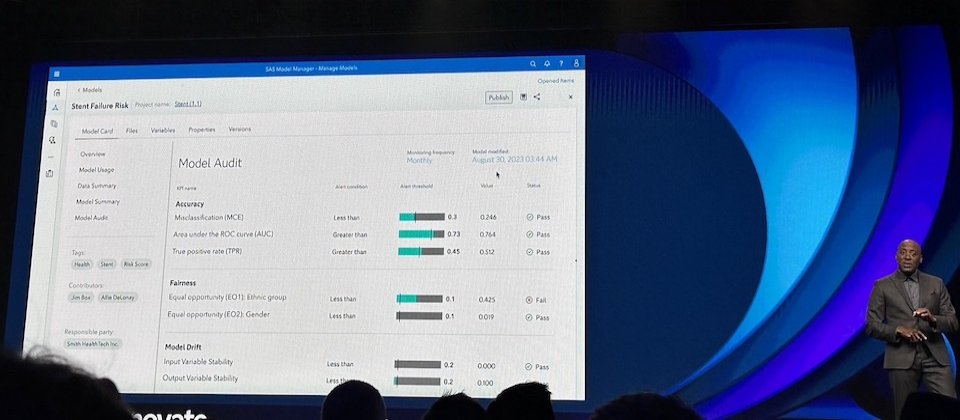

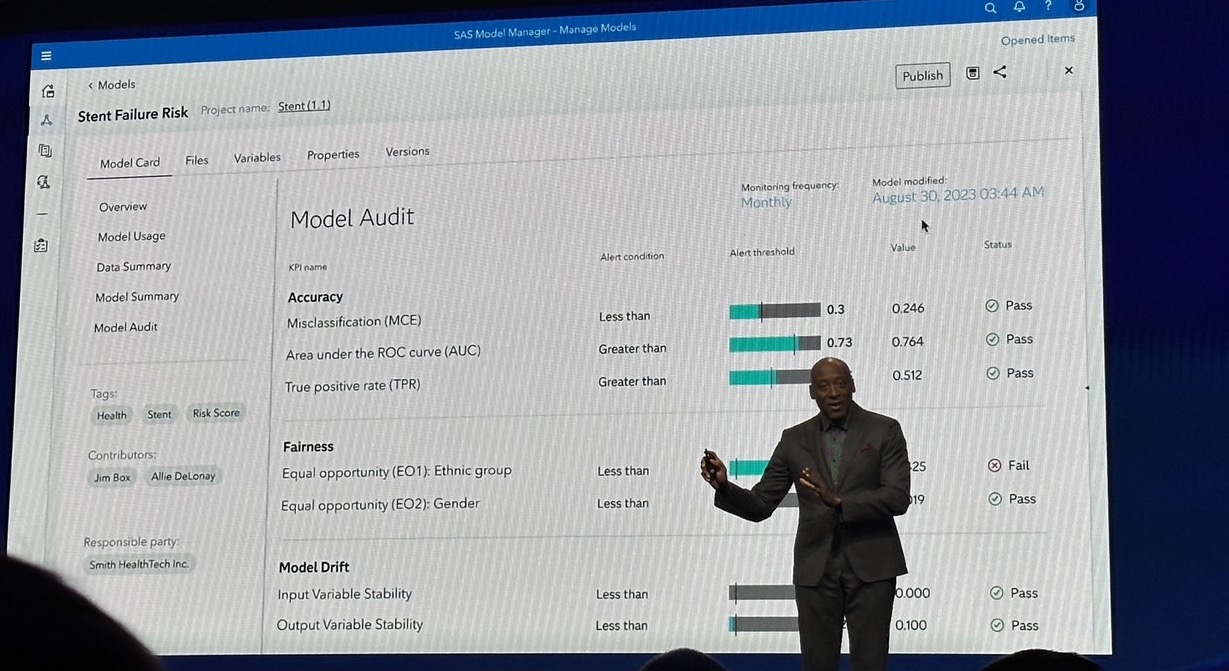

看准这个需求,负责推动数据伦理措施的SAS总监Reggie Townsend,今日揭露自家云端资料分析平台Viya上新添的模型卡功能(如下图),预计今年中正式上线。这个功能能让企业或组织内的利害关系人,不论是开发者还是董事会董事,都能查看易懂的模型重要资讯。

模型卡的运作方式是,直接根据SAS产品内容来为使用者注册的模型,自动产生模型卡,使用者不必手动建立。不只是SAS平台提供的模型,因SAS Viya已有用于管理开源的架构,因此也能替开源模型建立模型卡,目前从Python模型开始支援。

至于模型卡将显示的内容,会特别突显准确性、公平性和模型漂移等指标,尤其,模型漂移是模型性能随条件变化而下降的重要指标,可用来判断模型的适用性。除了这些,模型卡还包含详细的模型治理资讯,像是模型上次修改的时间、谁对此做出贡献、谁对模型负责,方便使用者组织解决模型性能异常问题。SAS表示,模型卡还涵盖模型使用资讯,可供企业或组织查明预期用途、超出范围的应用和限制讯息,这些资讯可因应企业业务营运所需的透明度和规范检查。

根据NIST AI风险管理框架量身打造AI治理工具和服务

另一方面,美国NIST在去年推出AI风险管理框架(AI RMF),是一份关于AI系统的设计、开发、部署和使用指南,也成为企业组织在缺乏官方法规的情况下,用来设计可信任和负责任AI的重要参考。Reggie Townsend本身也是美国商务部国家AI咨询委员会 (NAIAC) 成员,负责提供AI治理建议给白宫。

在这些基础上,SAS根据NIST AI风险管理框架,设计出一套可信任AI生命周期工作流程,来让企业和组织更容易实作NIST的AI风险管理框架。首先,SAS这款工作流程定义了个别角色和工作期望,并收集所需文件、列出考量因素,透过自动化来简化拥抱流程。之后,企业或组织使用者会得到一个正式模型,附带一个文件来说明他们已做好尽职调查,来确保模型是公平的,且作业流程不会造成任何伤害。

不只如此,这款工作流程还能让使用者记载,自家AI系统可能产生的影响考量。这之中就包含几个步骤,来确保训练资料能足够代表被影响的受众群体,且模型的预测能力和表现,在受保护的类别中都差不多。这些步骤可确保模型不会造成负面影响或伤害特定群体,而且,使用者还能建立人为介入(Human-in-the-loop)的任务,来确保模型一直准确。

目前,使用者可从SAS模型管理资源GitHub上下载可信任AI生命周期工作流程,之后也能在NIST AI风险中心下载。

不只如此,为更进一步提供现有客户AI监管和治理服务,SAS自己也成立AI治理顾问服务(AI Governance Advisory),透过会议方式来协助企业达到AI治理目标。SAS已试办这项顾问服务,其中欧洲最大的金融机构PZU波兰保险集团就有采用。