国产开源之光Qwen2终于发布啦!登顶开源模型之巅!

今天凌晨,阿里云通义千问发布技术博文,推出全球性能最强的开源模型Qwen2-72B,性能超过美国最强的开源模型Llama3-70B。

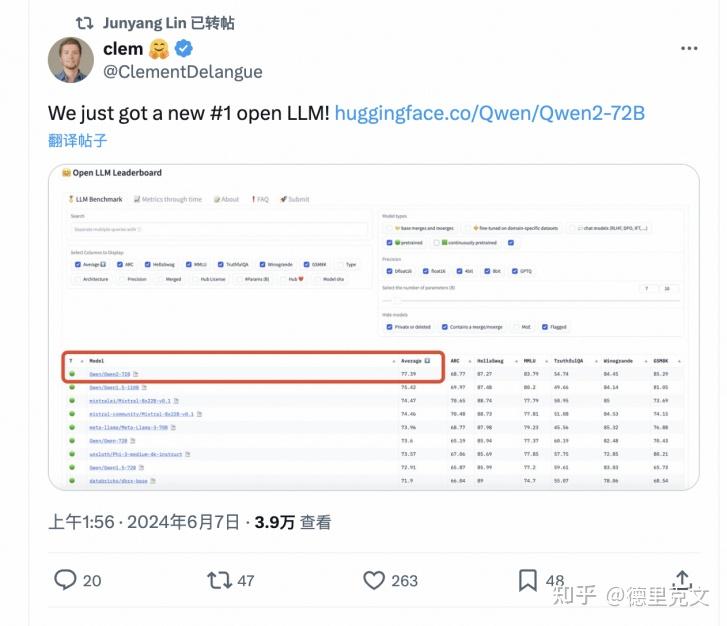

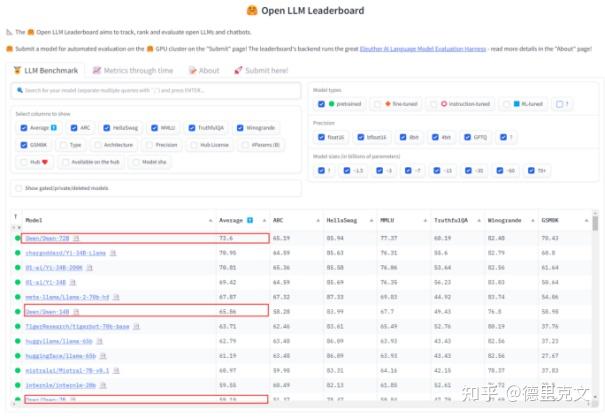

两小时后,全球最大开源社区HF的联合创始人兼首席执行官宣布,Qwen2-72B冲上HuggingFace 开源大模型榜单Open LLM Leaderboard第一名,全球排名最高!

一、模型介绍

先来看看官方公布的信息:

阿里云通义千问的技术博客介绍,Qwen2相比Qwen1.5实现了重大升级,具有以下特点:

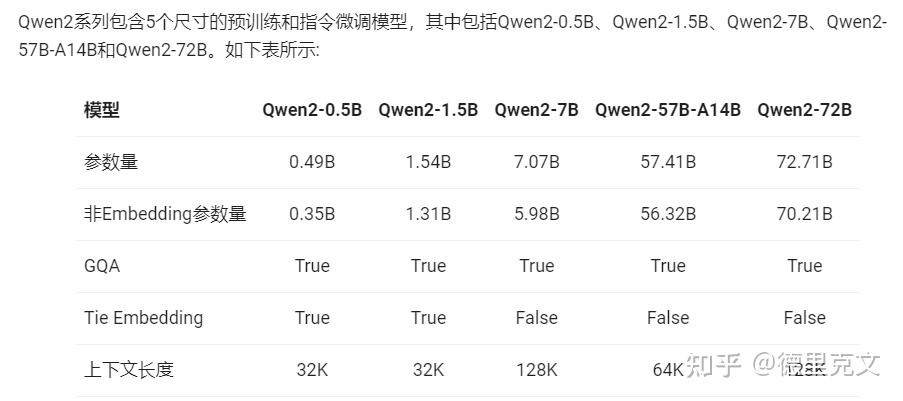

- 5个尺寸的预训练和指令微调模型, 包括Qwen2-0.5B、Qwen2-1.5B、Qwen2-7B、Qwen2-57B-A14B以及Qwen2-72B;

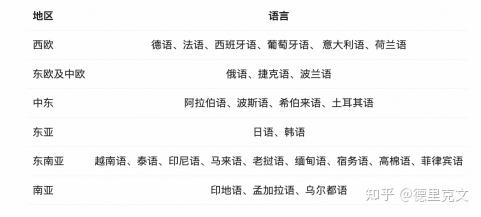

- 在中文英语的基础上,训练数据中增加了27种语言相关的高质量数据;

- 多个评测基准上的领先表现;

- 代码和数学能力显著提升;

- 增大了上下文长度支持,最高达到128K tokens(Qwen2-72B-Instruct)。

与2月份发布的Qwen1.5相比,Qwen2在整体性能上实现了显著的飞跃。

在权威的模型测评榜单OpenCompass中,Qwen1.5-110B已经领先于众多中国闭源模型。而最新开源的Qwen2-72B,其整体性能更是超越了Qwen1.5-110B,这也展现了阿里云在人工智能领域的持续创新和领先地位。

众多开源平台也第一时间支持Qwen2.

Qwen2系列已上线魔搭社区ModelScope和阿里云百炼平台,开发者可在魔搭社区体验、下载模型,或通过阿里云百炼平台调用模型API。魔搭社区模型下载地址:

Qwen2-72B

https://modelscope.cn/models/qwen/Qwen2-72BQwen2-72B-Instruct

https://modelscope.cn/models/qwen/Qwen2-72B-Instruct说的再好也不如实际上手体验一把,毕竟口碑是用出来而不是吹出来的,让我们来看看Qwen2的模型表现如何!

1、实际表现

我采用了魔塔社区的CompassArena 司南大模型竞技场进行比较,来看下我的测试!

https://modelscope.cn/studios/opencompass/CompassArena/summary我计划采用几个不同题目分别测试语言组织能力、逻辑判断能力和复杂问题解决能力。来看下我的初步测试吧:

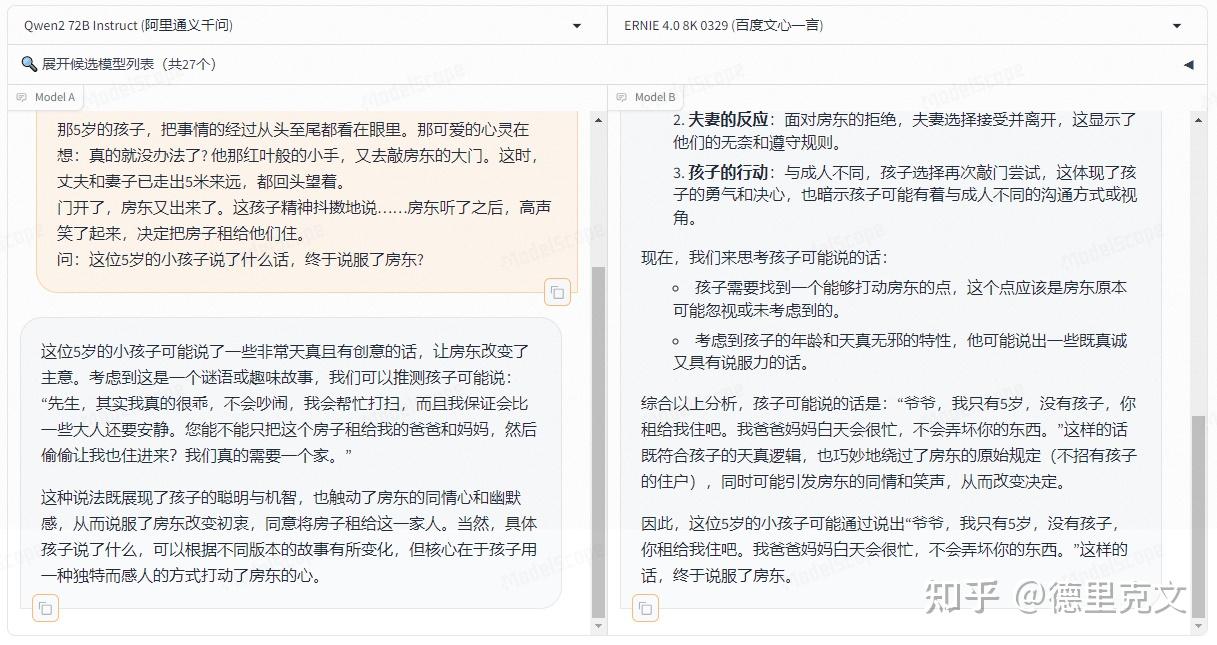

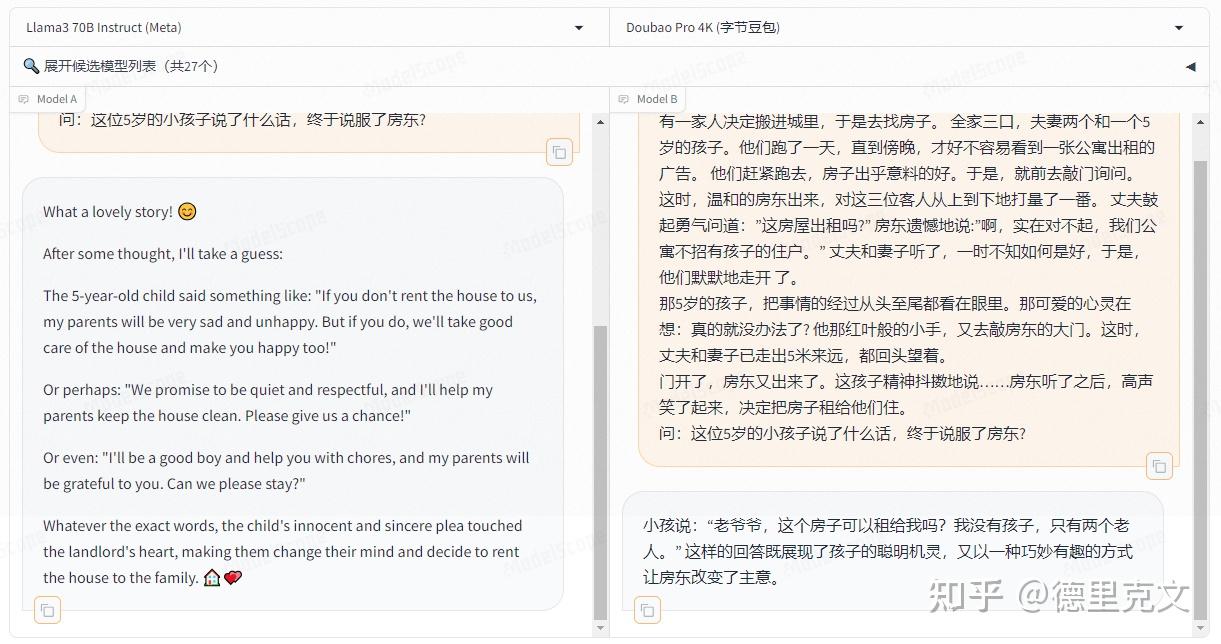

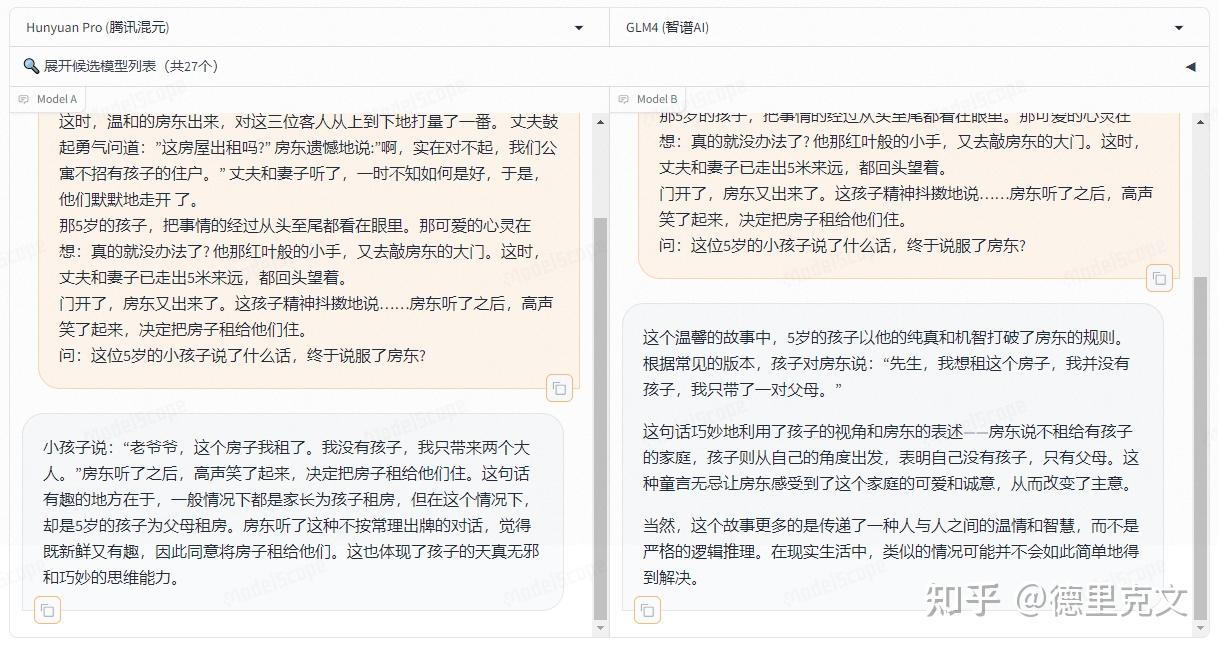

题目一:

有一家人决定搬进城里,于是去找房子。 全家三口,夫妻两个和一个5岁的孩子。他们跑了一天,直到傍晚,才好不容易看到一张公寓出租的广告。 他们赶紧跑去,房子出乎意料的好。于是,就前去敲门询问。 这时,温和的房东出来,对这三位客人从上到下地打量了一番。 丈夫鼓起勇气问道:”这房屋出租吗?” 房东遗憾地说:”啊,实在对不起,我们公寓不招有孩子的住户。” 丈夫和妻子听了,一时不知如何是好,于是,他们默默地走开 了。 那5岁的孩子,把事情的经过从头至尾都看在眼里。那可爱的心灵在想:真的就没办法了? 他那红叶般的小手,又去敲房东的大门。这时,丈夫和妻子已走出5米来远,都回头望着。 门开了,房东又出来了。这孩子精神抖擞地说……房东听了之后,高声笑了起来,决定把房子租给他们住。 问:这位5岁的小孩子说了什么话,终于说服了房东?

文字的力量每个人各自心中有答案,我个人觉得Qwen2的回答即可爱机灵,又解决了老爷爷担心的小孩破坏家里东西的担忧,会更胜一筹。

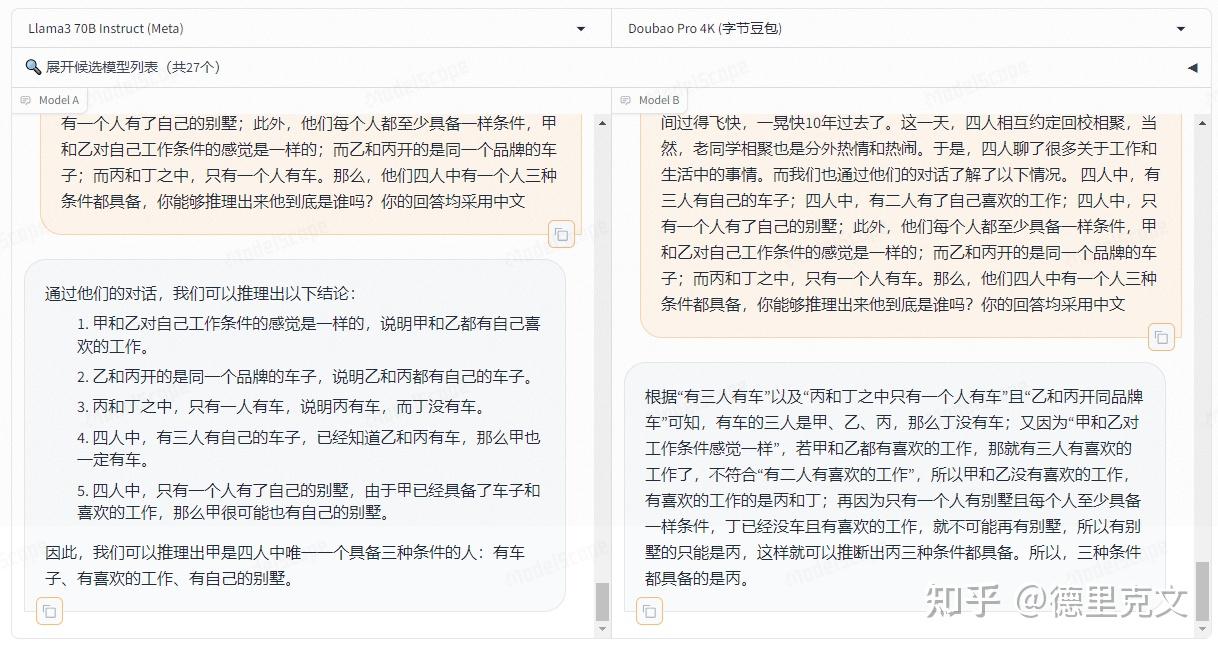

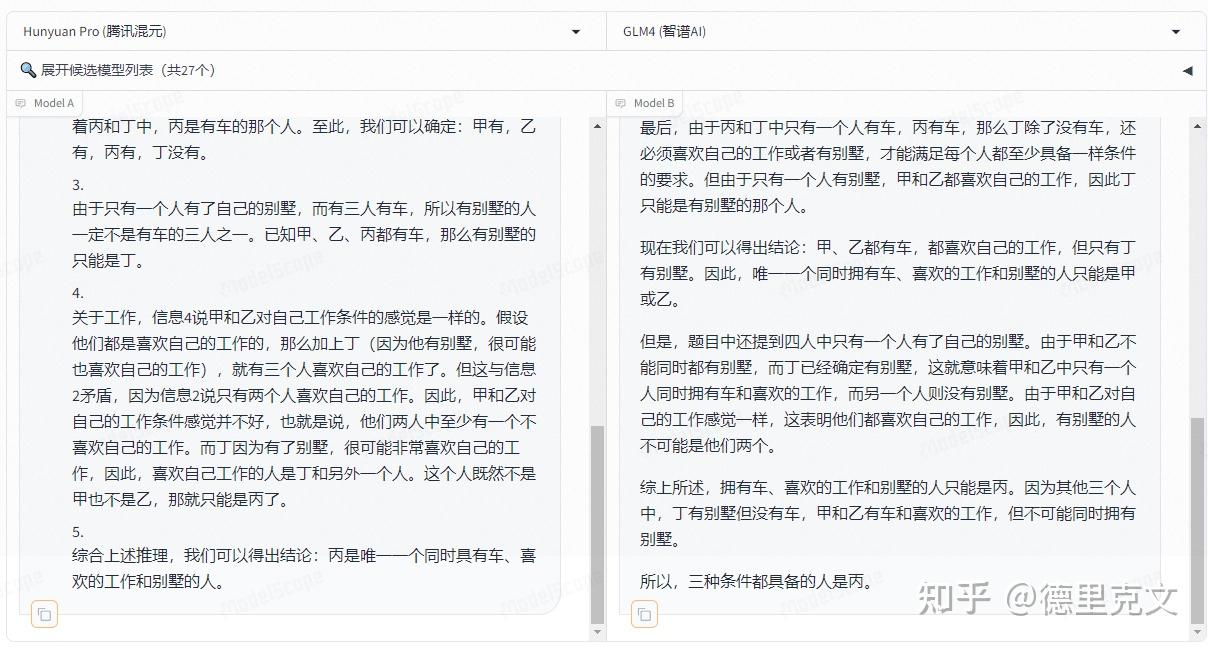

题目二:

甲、乙、丙、丁四人曾经就读于同一所大学,并且还是室友,这不,时间过得飞快,一晃快10年过去了。这一天,四人相互约定回校相聚,当然,老同学相聚也是分外热情和热闹。于是,四人聊了很多关于工作和生活中的事情。而我们也通过他们的对话了解了以下情况。 四人中,有三人有自己的车子;四人中,有二人有了自己喜欢的工作;四人中,只有一个人有了自己的别墅;此外,他们每个人都至少具备一样条件,甲和乙对自己工作条件的感觉是一样的;而乙和丙开的是同一个品牌的车子;而丙和丁之中,只有一个人有车。那么,他们四人中有一个人三种条件都具备,你能够推理出来他到底是谁吗?

先公布正确答案:丙

结果:这一盘国内几个大模型都对了,Llama3做错了

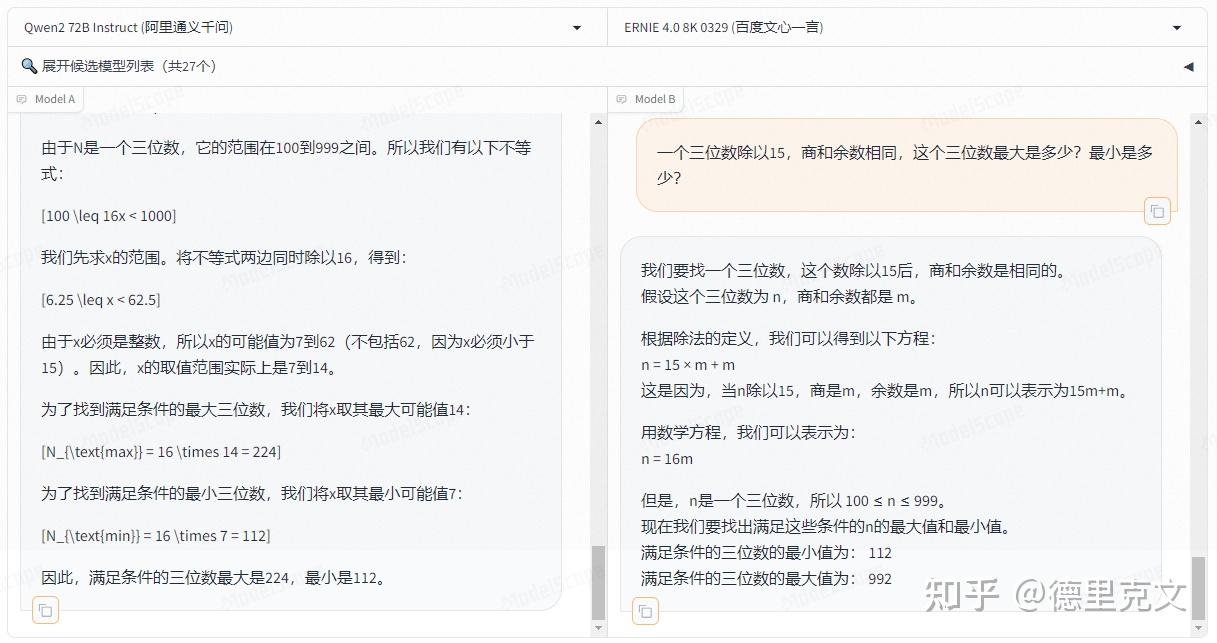

题目三:

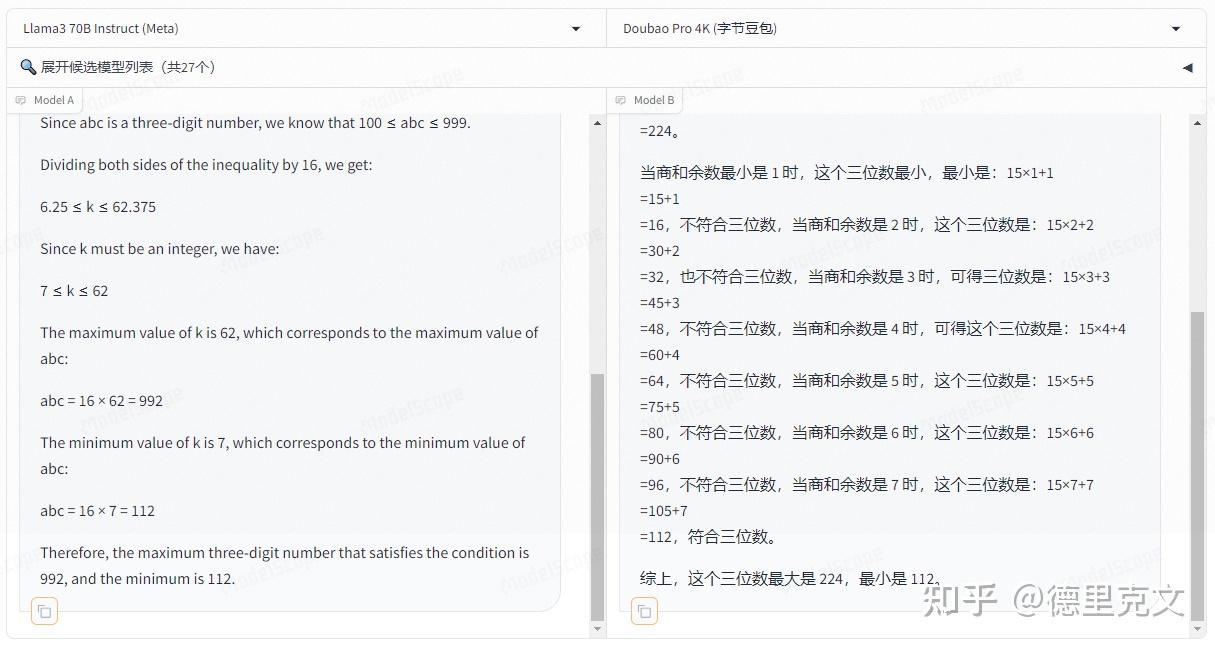

一个三位数除以15,商和余数相同,这个三位数最大是多少?最小是多少?

正确答案:最大为224,最小为 112

结果:Qwen和豆包正确

2、更多信息

从这次发布的信息来看,阿里通义千问的团队还专注于提升模型的多语言能力,特别是针对27种非中英文语言进行了增强,并优化了语言转换问题。

这是一个有野心的事情,阿里不仅仅想在国内卷。

他们的目标是走出去面向世界!

通过精细的微调,模型在代码、数学、推理等多方面能力得到提升,并更好地对齐人类价值观。

正是由于有这国际化的视野,Qwen2系列模型在开源社区中取得了显著的影响力,下载量和基于其开发的应用数量均大幅增长。

我非常敬佩通义千问团队坚持开源开放,通过开源社区的支持和反馈,不断优化和迭代技术的坚持。他们通过开源其先进AI模型,推动了全球AI技术的发展和应用。

大模型的生态建设对于AI技术的发展至关重要,它不仅可以避免大家重复造轮子的无意义资源浪费,还促进了技术的广泛应用和产业的智能化。

3、技术细节

目前阿里的详细技术报告还没有发布,不过在通义千问的技术博客上,可以看到一些端倪。

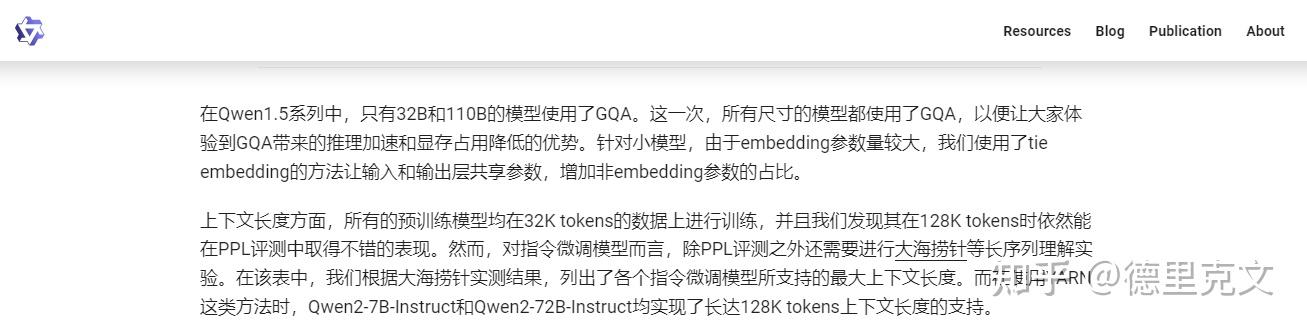

在Qwen1.5系列中,只有32B和110B的模型使用了GQA。

而这一次,所有尺寸的模型都使用了GQA。

GQA有什么进步呢?通俗来说,可以带来的推理加速和显存占用降低的优势,这是实用性的提升。

而对于小型模型,团队采用了tie embedding技术,通过共享输入和输出层的参数来优化模型结构。

上下文长度方面,研发团队在训练这些模型时,使用了包含32,000个词元(tokens)的数据集。

他们发现,即使是在处理更长的文本,比如128,000个词元(tokens)时,这些模型在PPL(一种衡量语言模型性能的指标)测试中仍然表现得很好。

但是,对于那些需要遵循特定指令的模型来说,仅仅通过PPL测试还不够,还需要通过一些更复杂的测试,比如“大海捞针”(这是一种测试模型理解长序列文本能力的方法)。

当使用像YARN这样的技术时,Qwen2系列中的两个特定模型(Qwen2-7B-Instruct和Qwen2-72B-Instruct)能够处理长达128,000个词元(tokens)的文本,这意味着它们能够理解和回应非常长的指令或文本内容。

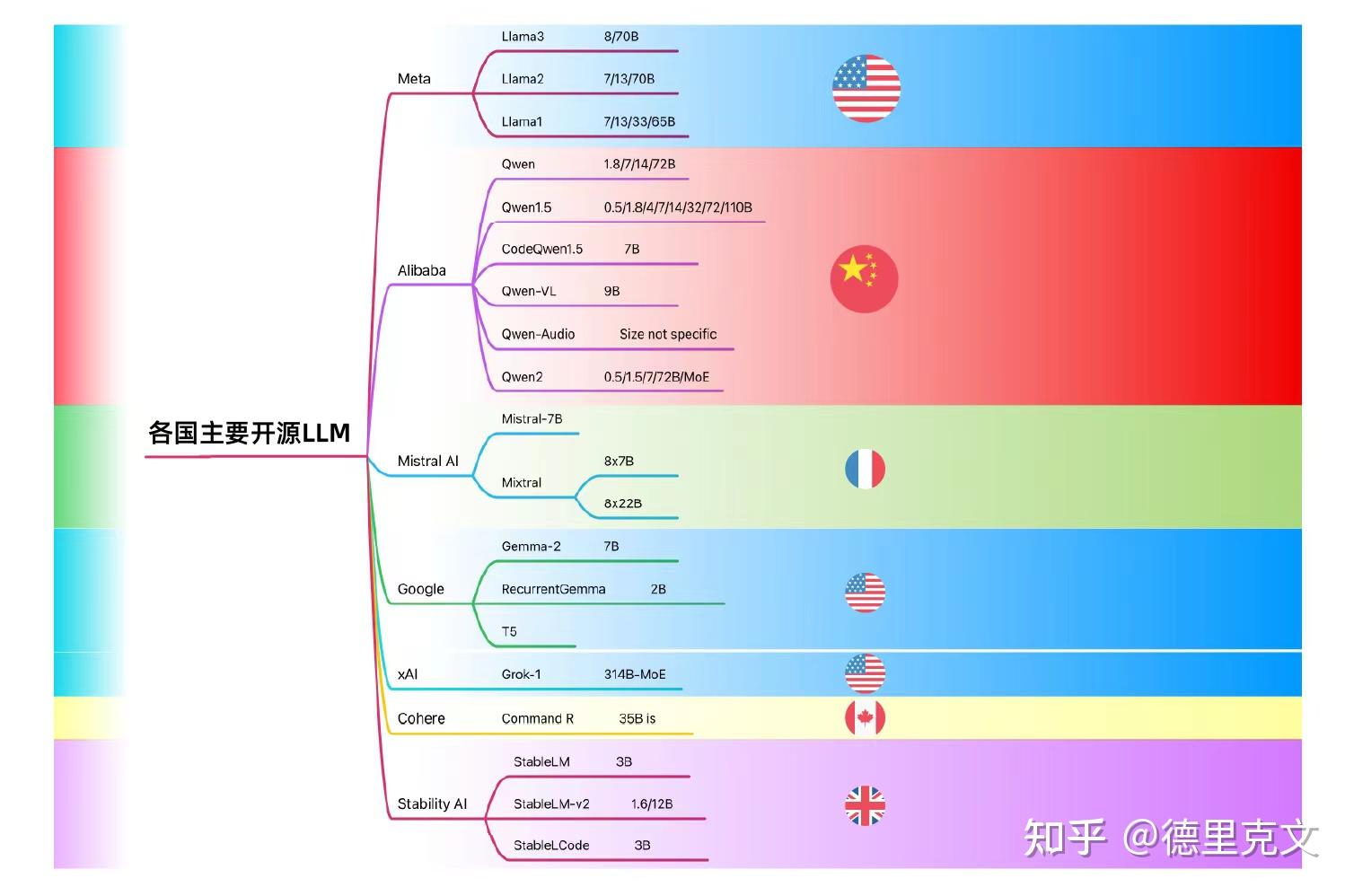

二、 开闭源模型之争

就在前几天,斯坦福大学某一小型AI团队抄袭国内面壁智能团队的开源大模型,引爆了舆论热点,让普通大众也了解到我们目前国产的人工智能语言大模型其实并不差。

从世界角度来看,中国的开源模型无论是质量还是 数量均不差。

而在其中最为亮眼的我觉得当属阿里的Qwen系列开源模型,在各项专业测评榜单中均取得了优异的成绩!

开源与闭源,孰优孰略?

这一波,Qwen为开源阵营再加上一分。

1、影响力

而在国产开源模型的领航者中,必然少不了Qwen这个开源大模型的功劳。

通义千问Qwen系列模型正在全球爆火,全球开源社区已经出现了超过1500款基于Qwen二次开发的模型。

Qwen 模型不断在各种业内权威平台上刷新了中国开源模型的荣耀,Qwen系列的72B、110B模型多次登顶HuggingFace 的Open LLM Leaderboard开源模型榜单。

就像Qwen-72B 曾登顶HuggingFace开源大模型排行榜(Open LLM Leaderboard),排名第一。充分证明了Qwen的泛用能力得到了国际认可。

而在对中国本土化的能力测试方面,Qwen-72B 也在 OpenCompass “开源基座大模型榜单”中夺冠。这可是业界公认最权威的中文能力评测榜单之一。

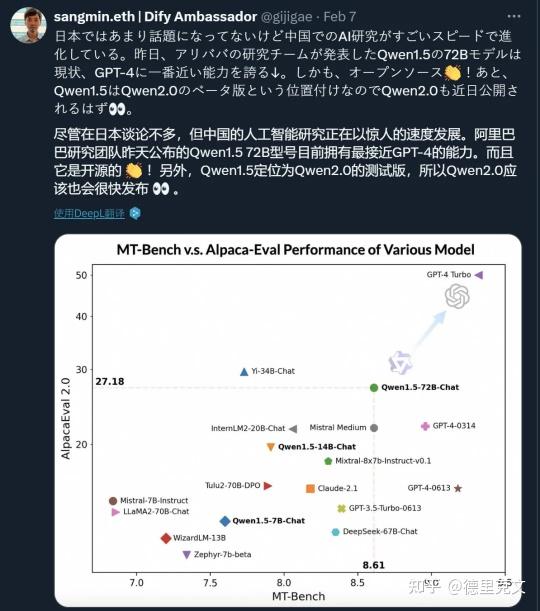

如此优秀的模型,其实早已走出国门,享誉全球,无论是国内还是国外的网友,近期都一直在期待着Qwen2.0的发布。

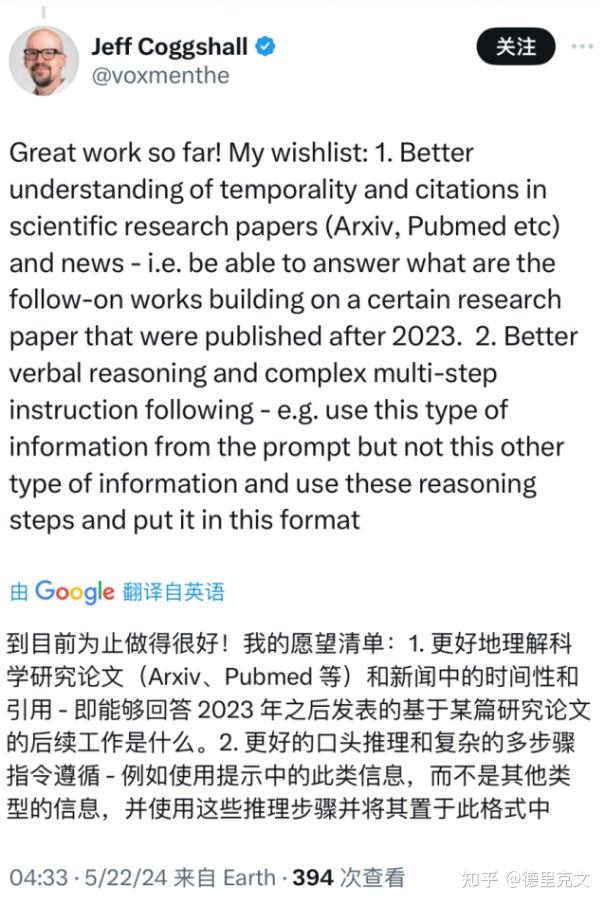

甚至在国外平台上,不少外国友人还对于Qwen2的国际化纷纷“许愿”,希望加入对该地区的更好本地化支持,一些对科研论文和逻辑性推理的提升,甚至是以要求全能战士的要求对待Qwen2。

这也足以说明Qwen2 在业内的期望值有多高。

开源,不正是为了打造一个良好的生态环境系统,不分地域的将全世界有识之士的能量汇聚在一起,共创未来吗?而现在,我们国产大模型也拥有比肩世界的能力了!https://xg.zhihu.com/plugin/6f9a3a6d151f5d95307586b096f5e36b?BIZ=ECOMMERCE

2、思考

我觉得开源模型是拥抱开放,更加有可能落地为各个行业进行AI赋能的产品。

未来,一定是行业+AI,而不是AI+行业。

专业人士+AI,一定能发挥比普通人+AI,甚至是AI专业人士+不熟悉的领域更大的作用。

我用AI绘画工具生成图片

我用AI绘画工具生成图片只有每个领域的专业人士将AI当成是这个领域的工具去用,才能发挥它的最大价值。

AI不是主树干,AI是赋能提效的强力工具,主次别搞反了。

而开源,给了每个行业可以进行微调定制化的方向,每个行业都可能迸发出不同的需求和思维的火花,去完善这一系统。

这就是开源的意义。

也是我看好开源大模型的原因。

结语

希望未来中国的开源大模型,能够不断刷新榜单,以Qwen为代表的中国开源大模型能够抗衡甚至超越国外的开源大模型,让美国企图封锁中国AI方向发展,对开源AI大模型进行出口管制,禁止中国人从事AI职业的法令彻底成为历史上的大笑话。

有了手机、新能源汽车的前车之鉴,为什么不能期待我们国家在AI人工智能这一次科技革命上再创伟业呢?

让我们见证历史,看国产大模型如何从追赶者变为领先者。

大国崛起,势不可挡!

我是德里克文,一个对AI绘画,人工智能有强烈兴趣,从业多年的设计师!如果对我的文章内容感兴趣,请帮忙关注点赞收藏,谢谢!